Všetky nástroje potrebné na to sú verejne dostupné a ľahko použiteľné aj pre amatérov. S filmovými scénami všetkého druhu sa dá manipulovať a tváre hercov sa dajú vymieňať. Používateľ Reddit to použil na obnovenie scény Leia z Rogue One bez rozpočtu 200 miliónov dolárov. Technológia môže mať vážne následky.

Po tom, čo jeden Redditor pred dvoma mesiacmi spôsobil rozruch svojimi klamlivo skutočnými porno falzifikátmi Gal Gadot a iných hviezd a hviezd, na Reddite sa objavila celá scéna. Subreddit r/deepfakes má teraz viac ako 38 000 členov, z ktorých mnohí sami manipulujú s pornografiou pridávaním náhodných tvárí do existujúceho filmu pomocou AI. Stačí im dostatok obrázkov ich nič netušiaceho cieľa a zopár verejne dostupných nástrojov. Jeden Redditor dokonca vytvoril aplikáciu, ktorú môžu použiť aj absolútni začiatočníci na vytváranie porna podporovaného AI.

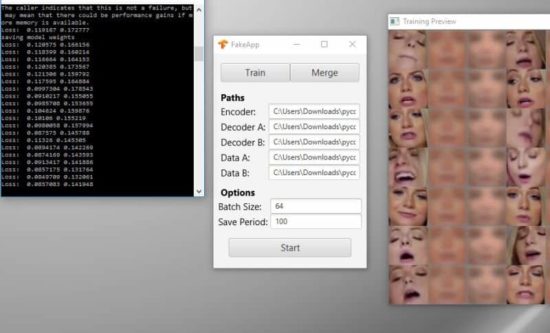

Redditor deepfakeapp vyvinula tzv Falošná aplikácia, ľahko použiteľná aplikácia, ktorá umožňuje komukoľvek manipulovať s pornografiou. „Myslím si, že aktuálna verzia aplikácie je dobrým východiskovým bodom, ale dúfam, že ju v najbližších dňoch a mesiacoch budem môcť ešte vylepšiť,“ povedal. „Chcem, aby si používatelia jednoducho vybrali video zo svojho počítača, stiahli si neurónovú sieť, do ktorej sa napája špecifická sada obrázkov z verejného archívu, a potom mohli vo videu zameniť tvár stlačením tlačidla.“

Napríklad Redditor UnobtrusiveBot umiestnil tvár Jessicy Alby na telo pornoherečky Melanie Rios pomocou FakeApp. „Bolo to super rýchle – momentálne sa učím, ako model preškoliť. "Trvalo to asi päť hodín - nie je to zlé pre výsledok," napísal v komentári. Redditor nuttynutter6969 tiež použil falošnú aplikáciu, aby premenil herečku Star Wars Daisy Ridley na neochotnú pornohviezdu.

Väčšina príspevkov v r/deepfakes má pornografický charakter, no niektorí používatelia vytvárajú aj videá, ktoré dokazujú, že technológia skutočne nemá žiadne obmedzenia, ak máte len tie správne nespracované údaje. Napríklad Redditor Z3ROCOOL22 spojil zábery Hitlera s argentínskym prezidentom Mauriciom Macrim. Podľa deepfakeapp každý, kto si stiahne FakeApp a má jedno alebo dve vysokokvalitné videá svojho cieľa, môže vytvárať realistické filmy.

Všetko, čo potrebujete, je dobrý grafický procesor s podporou CUDA. Používatelia, ktorí nemajú správny procesor, môžu využívať aj cloudové služby, ako je Google Cloud Platform. Celý proces od extrakcie údajov cez konverziu až po výmenu celej tváre údajne trvá približne XNUMX až XNUMX hodín, ak sa to robí správne. Niektorí používatelia uvádzajú, že im to trvalo oveľa dlhšie - niekedy s katastrofálnymi výsledkami.

deepfakeapp uvádza obzvlášť úspešný príklad Video používateľa derpfake, ktorý vytvoril FaceSwap princeznej Leie z Rogue One. „Vyššie môžete vidieť pôvodný Rogue One s podivnou počítačovo animovanou Carrie Fisher. Rozpočet filmu: 200 miliónov dolárov », opisuje derpfake svoje video. „Nižšie je 20-minútová manipulácia, ktorá mohla byť vytvorená s herečkou, ktorá vyzerá ako Carrie Fisher. Môj rozpočet: 0 dolárov a niekoľko albumov Fleetwood Mac.“ Namiesto drahého animovania tváre princeznej Leie v počítači derpfake nakŕmil softvér skutočnými zábermi mladej Carrie Fisher a vložil ich do filmových scén.

Technológia, ktorá komukoľvek uľahčuje falšovanie skutočných videí a ktorá sa vyvíja takým rýchlym tempom, by mohla mať vážne následky. Pretože fantázii sa medze nekladú: Bez ohľadu na to, či ide o porno z pomsty, zmanipulované nahrávky hviezd alebo politické prejavy, s potrebnými surovými dátami a niekoľkými open-source nástrojmi je možné sfalšovať akúkoľvek nahrávku. Čoskoro bude technológia taká dobrá, že nebude možné rozoznať rozdiel medzi skutočným videom a falošným vygenerovaným AI. Už teraz je pre ľudí čoraz ťažšie rozlíšiť medzi pravdou a falošnými správami a správy všetkého druhu sa šíria rýchlosťou blesku cez sociálne siete. Novinkou je, že technické prostriedky sú teraz dostupné každému. To podporuje celý princíp dôvery a dôveryhodnosti. Asi si budeme musieť zvyknúť na svet, v ktorom sú takéto videofejky čoraz lepšie a tým pádom aj ťažšie rozpoznateľné. Vrátane s tým spojených konfliktov s osobnostnými právami dotknutých osôb. V budúcnosti by sa takéto falzifikáty mohli použiť ako základ pre propagandu alebo zámerne zavádzajúce správy.

„Dravens Tales from the Crypt“ už viac ako 15 rokov očaruje nevkusnou zmesou humoru, serióznej žurnalistiky – pre aktuálne udalosti a nevyvážené spravodajstvo v politike tlače – a zombíkov, ozdobených množstvom umenia, zábavy a punk rocku. Draven zo svojho koníčka urobil obľúbenú značku, ktorá sa nedá zaradiť.

„Dravens Tales from the Crypt“ už viac ako 15 rokov očaruje nevkusnou zmesou humoru, serióznej žurnalistiky – pre aktuálne udalosti a nevyvážené spravodajstvo v politike tlače – a zombíkov, ozdobených množstvom umenia, zábavy a punk rocku. Draven zo svojho koníčka urobil obľúbenú značku, ktorá sa nedá zaradiť.